Grâce au GPU Blackwell B200 et au « superchip » GB200, Nvidia est devenue une entreprise valorisée à plusieurs milliers de milliards de dollars, potentiellement plus que Alphabet et Amazon réunis.

Selon Nvidia, son tout dernier GPU B200 embarque 208 milliards de transistors et peut délivrer jusqu’à 20 pétaflops de puissance FP4. En outre, l’association de deux de ces GPU avec un seul CPU Grace dans le modèle GB200 offre une hausse remarquable des performances, jusqu’à 30 fois, pour les tâches d’inférence des LLM. Cette combinaison a également le potentiel d’améliorer fortement l’efficacité. Nvidia affirme d’ailleurs qu’elle peut réduire les coûts et la consommation d’énergie jusqu’à 25 fois par rapport au modèle H100.

Auparavant, Nvidia affirmait que l’entraînement d’un modèle de 1,8 billion de paramètres aurait nécessité 8 000 GPU Hopper et 15 mégawatts de puissance. Toutefois, le PDG de l’entreprise indique désormais que cela peut être réalisé avec seulement 2 000 GPU Blackwell et une consommation de quatre mégawatts. Par ailleurs, sur un benchmark LLM GPT-3 de 175 milliards de paramètres, le GB200 offrirait, selon Nvidia, sept fois les performances d’un H100 et quatre fois la vitesse d’entraînement.

Lors de sa présentation aux journalistes, Nvidia a partagé des détails sur ses dernières avancées. L’entreprise a notamment évoqué un moteur de transformeur de deuxième génération, qui n’utilise que quatre bits par neurone au lieu de huit, doublant ainsi la capacité de calcul, la bande passante et la taille des modèles. Cela explique les impressionnants 20 pétaflops en FP4 mentionnés précédemment. Nvidia a également mis en œuvre un commutateur NVLink de nouvelle génération permettant la communication entre 576 GPU, avec une bande passante bidirectionnelle de 1,8 téraoctet par seconde. Pour y parvenir, l’entreprise a dû créer une nouvelle puce de commutation réseau dotée de 50 milliards de transistors et d’une puissance de calcul embarquée de 3,6 téraflops en FP8.

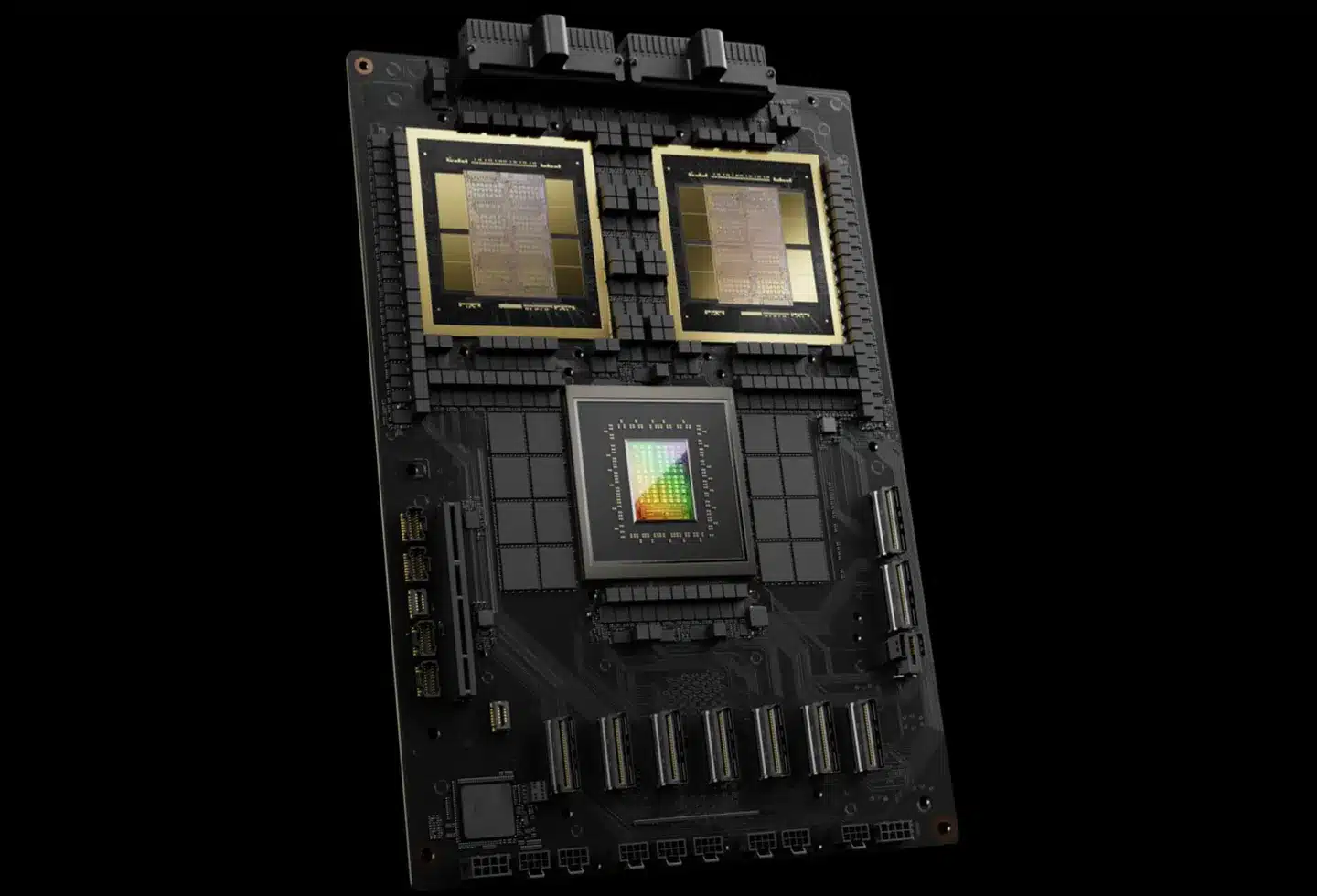

Selon Nvidia, auparavant, un groupe de 16 GPU passait la majeure partie de son temps à communiquer plutôt qu’à calculer. Naturellement, Nvidia s’attend à ce que les entreprises achètent ces GPU en grande quantité et a conçu des configurations plus importantes, telles que le GB200 NVL72. Ce rack contient 36 CPU et 72 GPU, tous refroidis par liquide, pour une performance combinée d’entraînement IA de 720 pétaflops, ou d’inférence de 1 440 pétaflops (également appelée 1,4 exaflops). Le rack compterait environ deux miles de câbles internes et un nombre impressionnant de 5 000 fils individuels.

Nvidia a annoncé que chaque rack héberge une combinaison de deux puces GB200 et de deux commutateurs NVLink, avec 18 ensembles des premières et neuf groupes des seconds par rack. Cette configuration permettrait de prendre en charge un modèle de 27 billions de paramètres, potentiellement y compris le supposé GPT-4, estimé à 1,7 billion de paramètres. De grands acteurs comme Amazon, Google, Microsoft et Oracle prévoiraient d’intégrer les racks NVL72 de Nvidia à leurs services cloud, bien que les quantités exactes n’aient pas été divulguées. En outre, Nvidia propose la solution complète avec son DGX Superpod pour DGX GB200, qui regroupe huit systèmes en un seul, pour un total impressionnant de 288 CPU, 576 GPU, 240 To de mémoire et une puissance de calcul de 11,5 exaflops en FP4.

Selon Nvidia, ses systèmes peuvent prendre en charge un grand nombre de superchips GB200 en utilisant soit l’InfiniBand Quantum-X800 (jusqu’à 144 connexions), soit l’ethernet Spectrum-X800 (jusqu’à 64 connexions), avec une vitesse réseau de 800 Gbps. Les annonces du jour ne devraient pas inclure de mises à jour sur les GPU gaming, car cette présentation provient de la GPU Technology Conference, qui se concentre généralement sur le calcul et l’IA plutôt que sur le jeu. Toutefois, on peut s’attendre à ce que l’architecture GPU Blackwell soit également utilisée dans les prochaines cartes graphiques de bureau RTX série 50.

Source : The Verge