Gracias a la GPU Blackwell B200 y al «superchip» GB200, Nvidia ha crecido hasta convertirse en una empresa multimillonaria en dólares, con un valor potencial superior al de Alphabet y Amazon combinados.

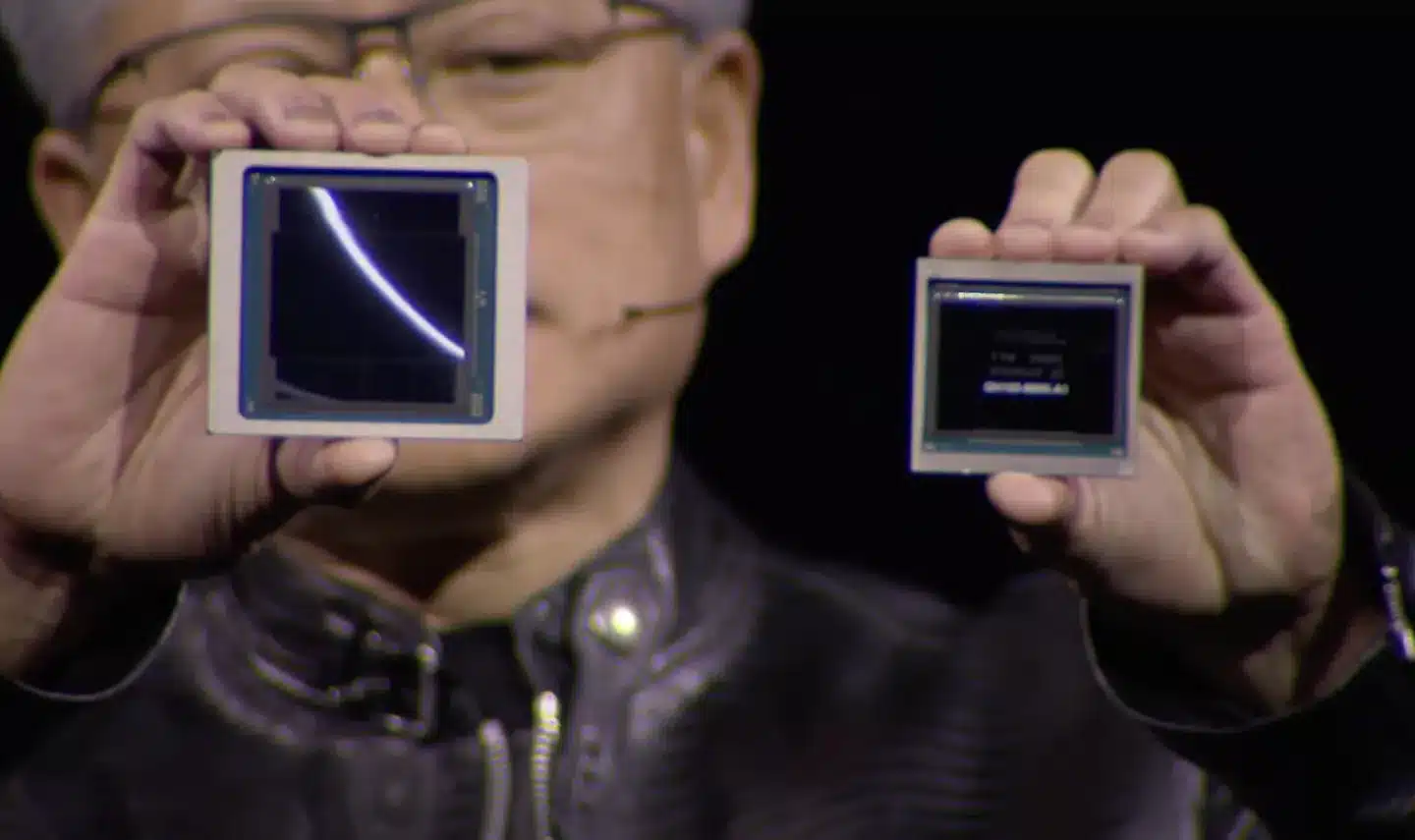

Según Nvidia, su última GPU B200 cuenta con 208 mil millones de transistores y puede ofrecer hasta 20 petaflops de potencia FP4. Además, la combinación de dos de estas GPU con una única CPU Grace en el modelo GB200 ofrece un notable aumento de 30 veces en el rendimiento para tareas de inferencia de LLM. Esta combinación también tiene el potencial de mejorar enormemente la eficiencia. De hecho, Nvidia afirma que puede reducir los costes y el consumo de energía hasta 25 veces en comparación con el modelo H100.

Anteriormente, Nvidia afirmó que entrenar un modelo de 1,8 billones de parámetros habría requerido el uso de 8.000 GPU Hopper y habría consumido 15 megavatios de energía. Sin embargo, el CEO de la compañía afirma ahora que esto se puede lograr utilizando solo 2.000 GPU Blackwell y consumiendo solo cuatro megavatios de energía. Además, en una prueba de rendimiento de LLM GPT-3 con 175 mil millones de parámetros, el GB200 ofrece siete veces el rendimiento de un H100 y cuatro veces la velocidad de entrenamiento, según Nvidia.

Durante su presentación a los periodistas, Nvidia compartió detalles sobre sus últimos avances. Mencionaron un motor transformador de segunda generación que utiliza solo cuatro bits por neurona en lugar de ocho, duplicando efectivamente la computación, el ancho de banda y el tamaño del modelo. Esto explica los impresionantes 20 petaflops de FP4 mencionados anteriormente. Además, Nvidia ha implementado un conmutador NVLink de próxima generación que permite la comunicación entre 576 GPU con un ancho de banda bidireccional de 1,8 terabytes por segundo. Para lograr esta hazaña, tuvieron que crear un nuevo chip de conmutador de red con 50 mil millones de transistores y su propia potencia de cómputo integrada de 3,6 teraflops de FP8.

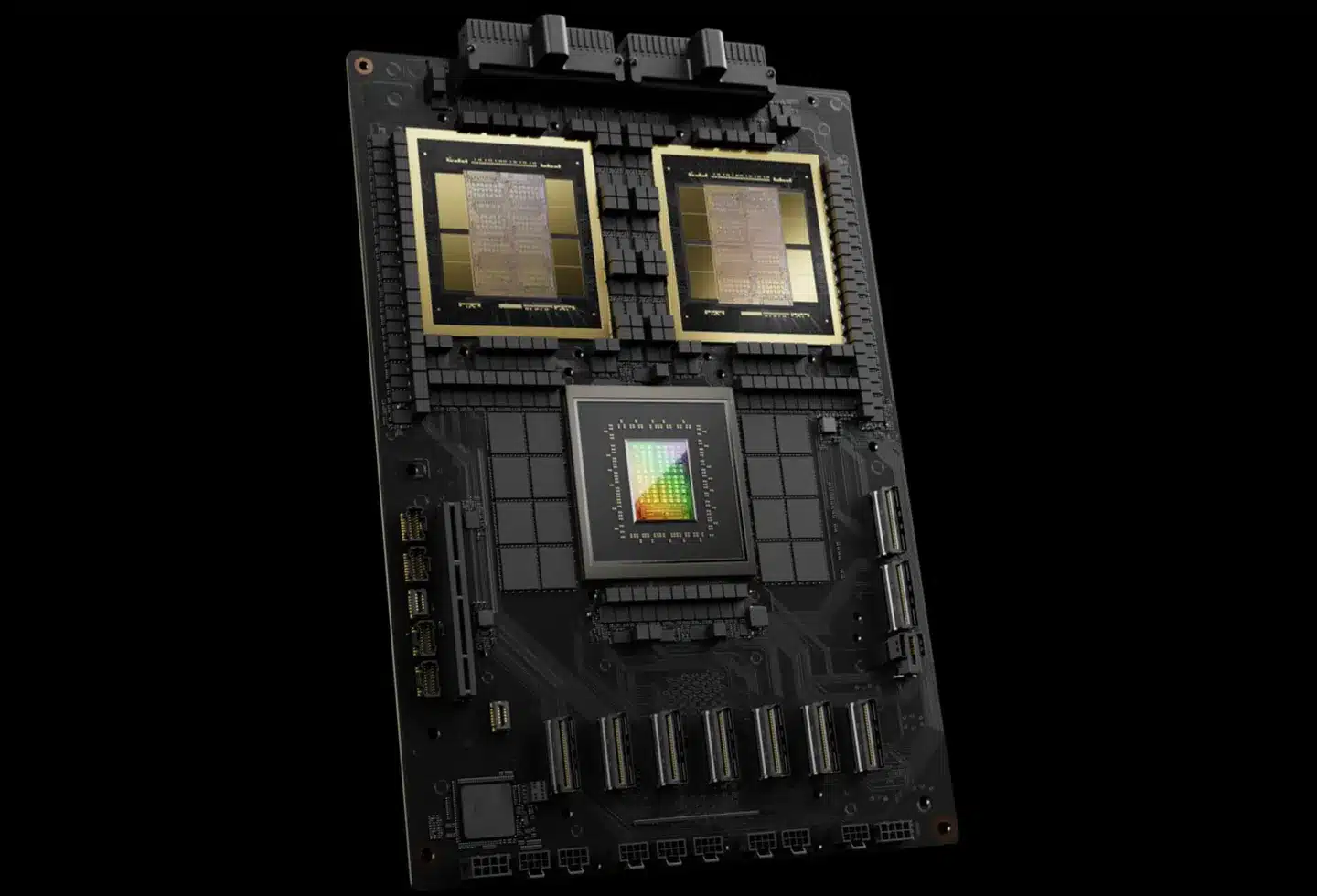

Según Nvidia, anteriormente un grupo de 16 GPU pasaría la mayor parte de su tiempo comunicándose en lugar de computando. Naturalmente, Nvidia anticipa que las empresas comprarán estas GPU al por mayor y ha creado configuraciones más grandes como el GB200 NVL72. Este rack contiene 36 CPU y 72 GPU, todas con refrigeración líquida, para un rendimiento combinado de entrenamiento de IA de 720 petaflops o unos impresionantes 1.440 petaflops (también conocidos como 1,4 exaflops) de inferencia. El rack cuenta con aproximadamente tres kilómetros de cables internos y consta de una asombrosa cantidad de 5.000 cables individuales.

Nvidia ha anunciado que cada rack alberga una combinación de dos chips GB200 y dos conmutadores NVLink, con 18 conjuntos de los primeros y nueve grupos de los segundos por rack. Esta configuración permite un modelo de 27 billones de parámetros, incluyendo potencialmente el rumoreado GPT-4, que se estima que tiene 1,7 billones de parámetros. Se informa que grandes actores como Amazon, Google, Microsoft y Oracle planean incluir los racks NVL72 de Nvidia en sus servicios en la nube, aunque no se han revelado cantidades específicas. Además, Nvidia ofrece la solución completa con su DGX Superpod para DGX GB200, consolidando ocho sistemas en uno para unos impresionantes 288 CPU, 576 GPU, 240 TB de memoria y una potencia de cómputo de 11,5 exaflops en FP4.

Según Nvidia, sus sistemas son capaces de soportar un gran número de superchips GB200 utilizando el Quantum-X800 InfiniBand (hasta 144 conexiones) o el Spectrum-X800 Ethernet (hasta 64 conexiones), con una velocidad de red de 800 Gbps. No se espera que las noticias de hoy incluyan actualizaciones sobre GPU para juegos, ya que este anuncio proviene de la GPU Technology Conference, que normalmente se centra en la computación y la IA en lugar de los juegos. Sin embargo, podemos anticipar que la arquitectura de GPU Blackwell también se utilizará en las próximas tarjetas gráficas de escritorio de la serie RTX 50.

Fuente: The Verge